Shadow IA : Le Risque Invisible de l'Architecture Moderne

Executive Summary

Le Shadow IA est une couche active et évolutive au sein des organisations modernes — une couche qui opère plus vite que la gouvernance, plus silencieusement que les politiques et plus profondément que ce que la plupart des dirigeants réalisent. Le risque n'est pas seulement la fuite de données, mais la perte structurelle de contrôle sur la manière dont l'information est créée, traitée et sécurisée.

L'Émergence du Shadow IA

Le Shadow IA désigne l'utilisation d'outils d'intelligence artificielle au sein d'une organisation sans l'autorisation officielle ou la supervision du département informatique. Ce n'est pas un phénomène nouveau, mais la vitesse à laquelle les outils d'IA (comme les LLM) sont adoptés en a fait un risque architectural critique.

Lorsque les employés utilisent des plateformes d'IA externes pour générer du code, analyser des données ou rédiger des rapports, ils contournent les contrôles de sécurité de l'organisation. Cela crée une infrastructure parallèle qui opère hors de vue de la direction.

Taxonomie des Risques

| Classe de Risque | Menace Primaire | Impact Systémique |

|---|---|---|

| Sécurité des Données | Fuite de données sensibles | Perte de propriété intellectuelle (PI) |

| Connaissance | Silos de chat privés | Érosion de la vérité institutionnelle |

| Conformité | Flux de données non surveillés | Exposition réglementaire |

Les Moteurs Psychologiques du Shadow IA

Addiction à l'Efficacité

Les outils d'IA offrent une récompense immédiate : des tâches qui prenaient autrefois des heures sont accomplies en quelques minutes. Cela crée une boucle de rétroaction où les employés deviennent dépendants de cet avantage de vitesse. Une fois cette dépendance installée, supprimer ou restreindre l'accès est perçu comme une perte de productivité — même si les risques sous-jacents sont considérables.

Innocuité Perçue

Contrairement au téléchargement de logiciels non autorisés, l'utilisation d'outils d'IA semble anodine. Cela ressemble à une recherche sur le web ou à l'utilisation d'une calculatrice. Cette perception diminue la vigilance. Le danger réside dans cette normalisation. Le Shadow IA n'est pas perçu comme une activité clandestine.

Externalisation Cognitive

L'IA ne se contente pas d'accélérer l'exécution. Elle réduit la charge cognitive. Les employés commencent à s'appuyer sur l'IA pour structurer leurs pensées, générer des idées et valider des hypothèses. Au fil du temps, cela déplace le siège de la réflexion du raisonnement interne vers la génération externe. À l'échelle, cela modifie la façon dont l'organisation pense.

Conséquences Architecturales

Perte d'Intégrité du Système

L'architecture d'entreprise repose sur des systèmes contrôlés, des flux de données définis et des interactions prévisibles. Le Shadow IA introduit des variables incontrôlées : entrées de données inconnues, logique de traitement non vérifiée, sorties non déterministes et dépendances externes.

Cela brise les hypothèses qui sous-tendent la conception du système. L'architecture ne reflète plus la réalité.

Incapacité à Auditer les Processus de Décision

Dans les environnements à haut risque, les décisions doivent être traçables. Le Shadow IA interrompt cela en insérant des étapes opaques dans la chaîne de décision. Si une analyse a été partiellement générée par un modèle externe et que cette interaction n'est pas enregistrée, l'organisation perd en visibilité. C'est un échec de la gouvernance.

Désalignement entre Workflows Officiels et Réels

Les processus documentés deviennent obsolètes lorsque les employés adoptent des alternatives non officielles plus rapides. Cela crée une divergence : les workflows officiels reflètent la politique ; les workflows réels reflètent le comportement. L'organisation opère sur une couche système non documentée que la direction ne contrôle pas.

Réponse Stratégique : Contrôle sans Friction

Combler le Fossé de Vitesse

Le moyen le plus efficace de réduire le Shadow IA n'est pas l'interdiction, mais le remplacement. Les organisations doivent fournir des systèmes d'IA internes qui égalent ou dépassent la vitesse et l'ergonomie des outils externes. Si les solutions internes sont plus lentes ou complexes, les employés continueront de les contourner. La performance, c'est la gouvernance.

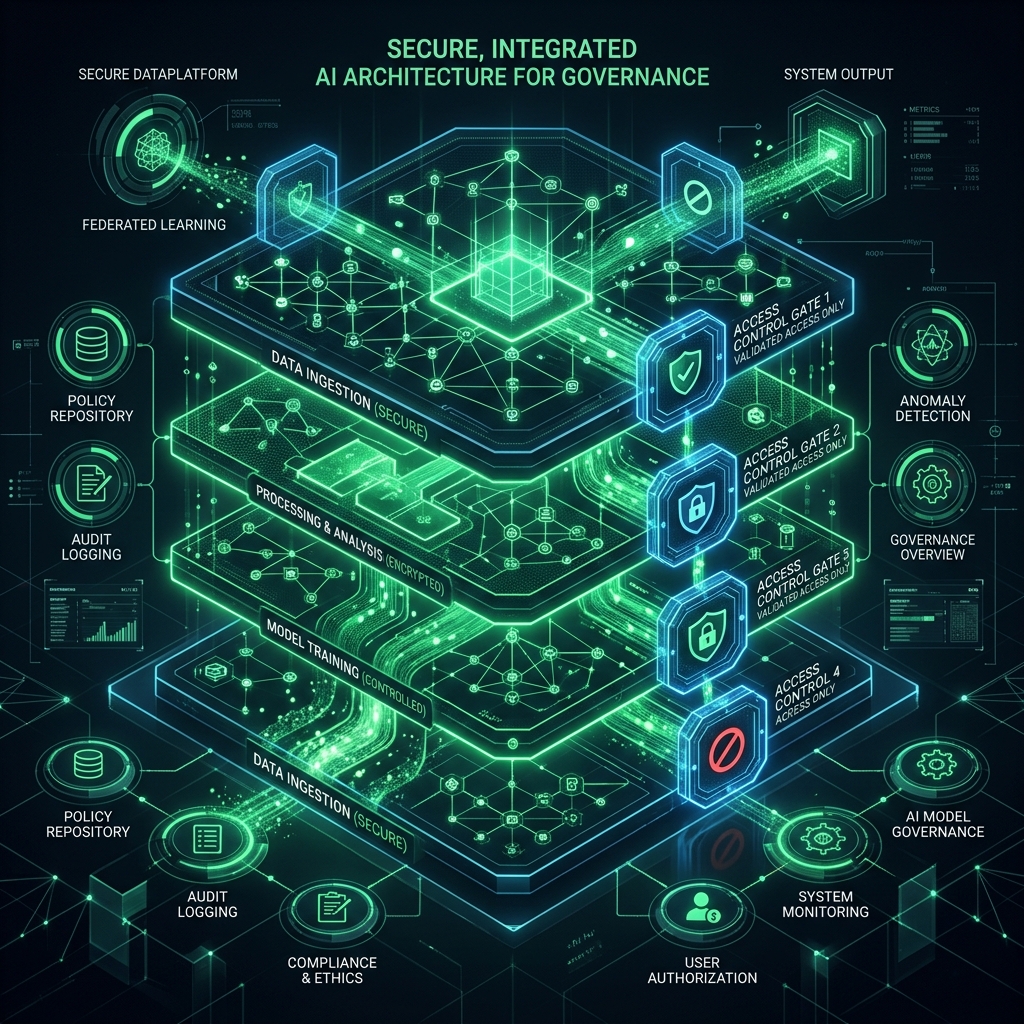

Bâtir une Infrastructure IA Sanctionnée

- ▸Déploiements sécurisés de modèles internes ou privés

- ▸Passerelles API contrôlées

- ▸Couches de gouvernance des données restreignant les entrées sensibles

- ▸Journalisation et pistes d'audit pour toutes les interactions

- ▸Contrôles d'accès basés sur les rôles

Définir des Limites d'Utilisation Claires

Les politiques doivent être précises, pas abstraites. Les employés doivent comprendre : quelles données peuvent être partagées, quels outils sont approuvés et quelles étapes de vérification sont requises. La précision favorise la conformité.

Surveiller les Comportements, pas seulement les Systèmes

Le Shadow IA ne peut pas être géré uniquement par l'infrastructure. Il nécessite une visibilité comportementale. L'objectif n'est pas la surveillance, mais la connaissance de la situation.

Former au Jugement, pas seulement aux Outils

L'alphabétisation IA ne consiste pas à apprendre aux employés à utiliser des outils, mais à leur apprendre quand ne pas leur faire confiance. Les organisations doivent développer des compétences d'évaluation critique pour les résultats de l'IA.

L'État Futur : Intelligence Intégrée, pas de Systèmes Fantômes

L'IA doit faire partie de l'Architecture

La solution à long terme n'est pas le confinement, mais l'intégration. L'IA doit opérer dans l'environnement contrôlé de l'organisation, alignée sur ses modèles de données et ses protocoles de sécurité. Lorsqu'elle est correctement intégrée, l'IA devient un amplificateur de l'intelligence organisationnelle.

La Visibilité est la nouvelle Couche de Contrôle

Dans un monde où les interactions IA façonnent les décisions, la visibilité devient critique. Sans visibilité, le contrôle est impossible.

Conclusion : Ce que vous ne voyez pas transformera votre organisation

Le Shadow IA n'est pas une menace future, c'est une couche active au sein des organisations modernes. Le risque est structurel : la perte graduelle du contrôle sur la façon dont l'information est créée et traitée. Les organisations qui ignorent le Shadow IA perdront leur cohérence. La précision exige de la visibilité. La performance exige du contrôle.